ترجمة وتحرير: نون بوست

أثار استخدام الذكاء الاصطناعي في الطب موجة من التوقعات وأملا كبيرا في تقدّم العلاج. ويشير الذكاء الاصطناعي بشكل عام إلى قدرة أجهزة الحاسوب على محاكاة الذكاء البشري والتعلم. ومن خلال استخدام التعلم الآلي، مثلا، يعمل العلماء على تطوير خوارزميات تساعدهم على اتخاذ قرارات متعلّقة بعلاج السرطان. كما يأمل الباحثون أن تتمكن أجهزة الحاسوب مستقبلا من تحليل الصور الإشعاعية والتمييز بين الأورام السرطانية التي ستكون قادرة على الاستجابة بشكل جيّد للعلاج الكيميائي وتلك التي لن تعالج.

لكن استخدام الذكاء الاصطناعي في الطب يطرح جملة من التحديات القانونية والأخلاقية الكبيرة، التي يتعلّق العديد منها بمخاوف بشأن الخصوصية والتمييز والضرر النفسي والعلاقة بين الطبيب والمريض. وفي مقال سيصدر قريبا، أرى أنه ينبغي على صانعي السياسة وضع عدد من الإجراءات المتعلّقة بالذكاء الاصطناعي كما هو الحال عندما أصبح الفحص الجيني أمرا شائعا.

احتمال ممارسة التمييز

يشتمل عمل الذكاء الاصطناعي على تحليل كميات هائلة من البيانات لتمييز النماذج، التي يقع استخدامها إثر ذلك للتنبؤ باحتمال وقوع أحداث مستقبلية. في مجال الطب، يمكن أن تُجمع مجموعات البيانات من السجلات الطبية الإلكترونية ومطالب التأمين الصحي، إلى جانب عدة مصادر أخرى مثيرة للدهشة. ويمكن أن تستفيد تكنولوجيا الذكاء الاصطناعي من سجلات الشراء وبيانات الدخل والسجلات الجنائية وحتى وسائل التواصل الاجتماعي للحصول على معلومات حول الحالة الصحية للفرد.

يتمثّل الأمل في أن يتمكّن الذكاء الاصطناعي من قراءة الصور الإشعاعية بكفاءة أكثر من الإنسان.

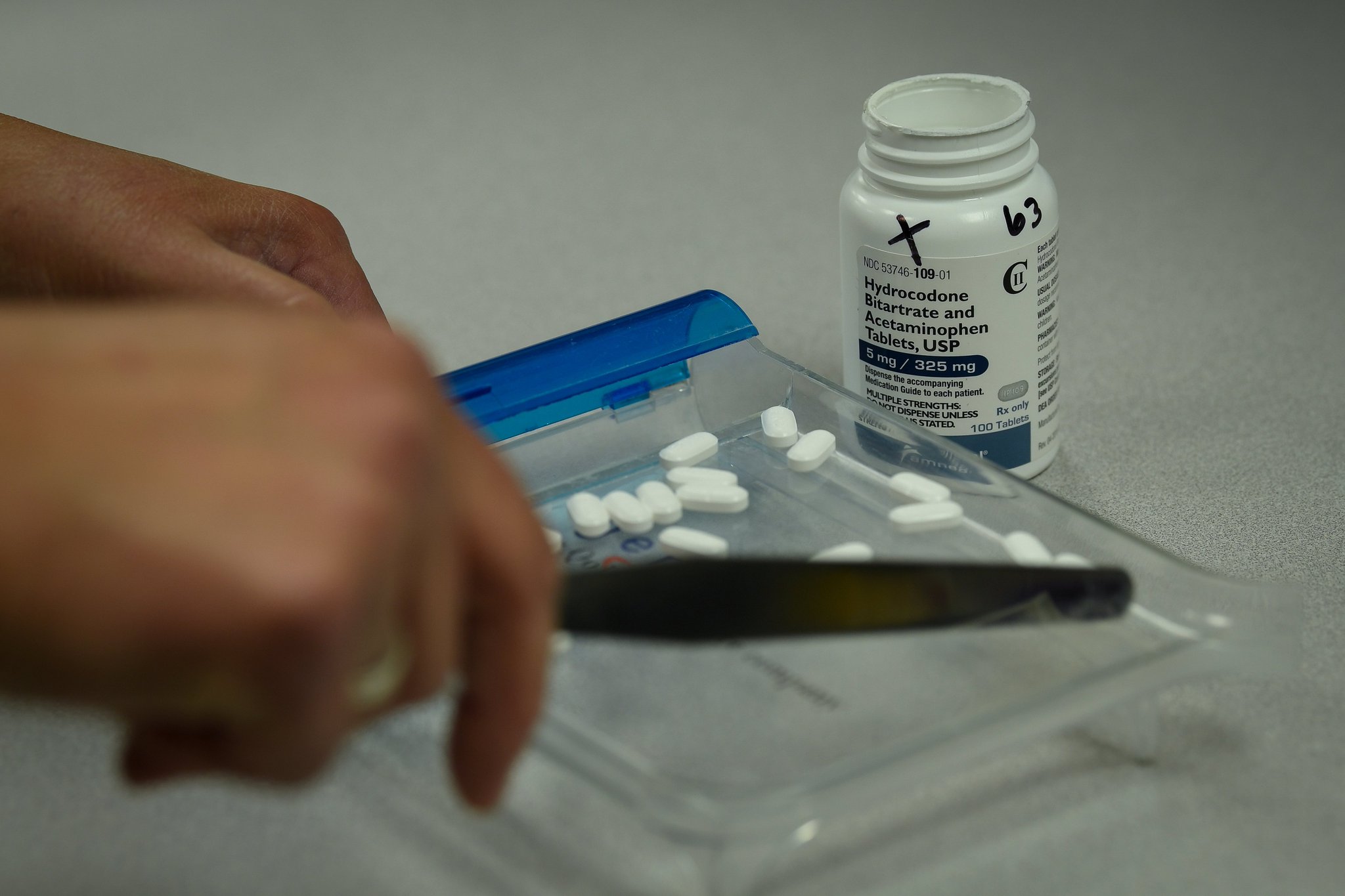

يستخدم الباحثون الذكاء الاصطناعي للتنبؤ بالعديد من الحالات المرضية في المستقبل، التي تشمل أمراض القلب والسكتة الدماغية ومرض السكري والاختلال المعرفي، وتعاطي المسكّنات الأفيونية وحتى الانتحار. فعلى سبيل المثال، يستخدم فيسبوك خوارزمية تقوم بالتنبؤ بالانتحار استنادًا إلى المنشورات التي تحتوي على عبارات مثل “هل أنت بخير؟” مقترنة بعبارة “وداعًا” و”من فضلك لا تفعل ذلك”.

في الوقت الراهن، تثير القدرة التنبؤية مخاوف أخلاقية كبيرة في مجال الرعاية الصحية. ففي حال كانت تكنولوجيا الذكاء الاصطناعي قادرة على التنبؤ بالحالة الصحية للشخص، فإنه من المحتمل أن يقع إدراج المعلومات المتعلقة بها في السجلات الطبية الإلكترونية.

تستخرج الشركات العملاقة في مجال جمع البيانات، على غرار “ليكسز نيكسز” و”أكسيكوم”، البيانات الشخصية وتنخرط في أنشطة الذكاء الاصطناعي

يمكن لأي شخص يملك حق الولوج إلى السجلات الطبية أن يطلّع على التنبؤات حول الاختلال المعرفي أو تعاطي المسكّنات الأفيونية. ويُذكر أن العشرات أو حتى المئات من الأطباء والمسؤولين يطلّعون على السجلات الطبية للمرضى أثناء العلاج الطبي. وغالبًا ما يسمح المرضى للآخرين بالوصول إلى سجلاتهم، مثلا، عندما يتقدمون للحصول على عمل أو تأمين على الحياة.

تستخرج الشركات العملاقة في مجال جمع البيانات، على غرار “ليكسز نيكسز” و”أكسيكوم”، البيانات الشخصية وتنخرط في أنشطة الذكاء الاصطناعي. إثر ذلك، يمكن لهذه الشركات بيع التنبؤات الطبية لأي طرف ثالث مهتم، بما في ذلك المسوّقين والمُشغّلين والمقرضين وشركات التأمين على الحياة وغيرها. نظرًا لكون هذه الشركات ليست من مقدمي الرعاية الصحية أو خدمات التأمين، فإن قاعدة الخصوصية المنضوية تحت قانون قابلية التأمين الصحي والمساءلة لا تنطبق عليها. لذلك، لا تحتاج هذه الشركات لطلب إذن من المرضى للحصول على معلومات حولهم، كما تملك الحرية للكشف عنها.

لا يحظر ﻗﺎﻧﻮﻥ ﺍﻷﻣﺮﻳﻜﻴﻮﻥ ﺫﻭي ﺍﻻﺣﺘﻴﺎﺟﺎﺕ ﺍلخاﺻﺔ التمييز على أساس المشاكل الطبية المستقبلية، وهذا ينطبق فحسب على الحالات المرضية الحالية والسابقة

إن الكشف عن مثل هذه المعلومات يمكن أن يؤدي إلى التمييز. فعلى سبيل المثال، سيولي أصحاب العمل اهتماما بالعمال الذين سيكونون في صحة جيدة وقادرين على الإنتاج، مع تراجع احتمال تغيّبهم عن العمل وانخفاض التكاليف الطبية. وفي حال أدرك المشغّلون أن المتقدمين للوظائف سيكونون عرضة للإصابة بالأمراض في المستقبل، فمن المحتمل ألا يقدموا على تعيينهم. وعلى هذا النحو، قد يتخذ المقرضون وأصحاب العقارات وشركات التأمين على الحياة وغيرها قرارات بالرفض بشأن الأفراد بناءً على تنبؤات الذكاء الاصطناعي.

انعدام وجود ضمانات حماية

لا يحظر ﻗﺎﻧﻮﻥ ﺍﻷﻣﺮﻳﻜﻴﻮﻥ ﺫﻭي ﺍﻻﺣﺘﻴﺎﺟﺎﺕ ﺍلخاﺻﺔ التمييز على أساس المشاكل الطبية المستقبلية، وهذا ينطبق فحسب على الحالات المرضية الحالية والسابقة. وردّا على الاختبار الجيني، سنّ الكونغرس قانون عدم التمييز وفقا للمعلومات الجينية. ويمنع هذا القانون أصحاب العمل وشركات التأمين الصحي من أخذ المعلومات الوراثية بعين الاعتبار واتخاذ القرارات بناءً على الافتراضات ذات الصلة بالحالات الصحية للأشخاص في المستقبل. ولكن لا يوجد قانون يفرض حظرا مماثلا بخصوص البيانات التنبؤية غير المتعلّقة بالجينات.

يمكن للذكاء الاصطناعي أن يتنبأ نظريًا باستخدام المريض لأشباه الأفيونات.

يمكن أن يؤدي التنبؤ بالحالة الصحية باستخدام تكنولوجيا الذكاء الاصطناعي إلى حدوث ضرر نفسي. فعلى سبيل المثال، يمكن أن يصاب العديد من الأشخاص بصدمة في حال علموا أنهم من المحتمل أن يعانوا من الاختلال المعرفي في المستقبل.

من الممكن أيضا أن يحصل الأفراد على تكهّنات بشأن حالتهم الصحية مباشرة من الكيانات التجارية التي اشترت بياناتهم. ولك أن تتخيل ما سيحدث عندما تتلقى أخبارا تفيد بأنك ستكون عرضة لخطر الإصابة بالخرف من خلال إعلان إلكتروني يحثك على شراء منتجات محسّنة للذاكرة.

عندما يتعلق الأمر بالاختبار الجيني، يُنصح المرضى بالحصول على استشارة أخصائيين حتى يتمكنوا من اتخاذ قرار مدروس حول مدى استعدادهم للخضوع لمثل هذا النوع من الاختبارات وفهم نتائج الاختبار بشكل أفضل. في المقابل، لا نملك مستشارين متخصصين في تكنولوجيا الذكاء الاصطناعي لتقديم خدمات مماثلة للمرضى.

يجب على الأطباء الذين يزودون المرضى بتنبؤات الذكاء الاصطناعي التأكد من تقديم معلومات لهم حول إيجابيات وسلبيات مثل هذه التوقعات

فضلا عن ذلك، يوجد هاجس آخر يتعلق بالعلاقة بين الطبيب والمريض. هل يقلل الذكاء الاصطناعي من دور الأطباء؟ هل ستكون أجهزة الحاسوب هي التي تقوم بالتنبؤات وعمليات التشخيص وعلاج المرضى، بينما ينفّذ الأطباء ببساطة التعليمات الصادرة عن أجهزة الحاسوب؟ كيف سيكون شعور المرضى تجاه أطبائهم إذا كانت أجهزة الحاسوب تلعب دورا أكبر في اتخاذ القرارات الطبية؟

نداء لتوخي الحذر

ما الذي يمكن فعله لحماية الجمهور الأمريكي؟ لقد ناقشت في المقال السابق مسألة توسيع قاعدة الخصوصية في قانون قابلية التأمين الصحي والمساءلة، ما يمكن من اكتشاف أمر أي شخص يريد أن يستغل المعلومات الصحية لأغراض تجارية. يجب ألا تنطبق حماية الخصوصية على مزودي الرعاية الصحية وشركات التأمين فحسب، بل على المؤسسات التجارية أيضا. كما ذكرت أنه على الكونغرس تعديل القانون المتعلق بالأمريكيين ذوي الاحتياجات الخصوصية لحظر التمييز بناءً على توقعات الأمراض المستقبلية.

يجب على الأطباء الذين يزودون المرضى بتنبؤات الذكاء الاصطناعي التأكد من تقديم معلومات لهم حول إيجابيات وسلبيات مثل هذه التوقعات. وينبغي على الخبراء تقديم المشورة للمرضى حول الذكاء الاصطناعي على غرار ما يقوم به المهنيون المدربون بشأن الاختبارات الجينية.

من المحتمل أن تثير الآفاق التي يمكن أن يفتحها الذكاء الاصطناعي مخاوف الناس. ولضمان أن يكون الذكاء الاصطناعي معززا لسلامة المرضى بشكل فعلي، يجب على الأطباء والباحثين وصانعي السياسات إدراك مخاطره والمضي قدما في تطويره بكل حذر.

المصدر: ذا كونفرسيشن